Extremismus im Netz: Wie soziale Medien Radikalisierung befördern

TikTok, Telegram, X — wo Verschwörungstheorien gedeihen

Die Radikalisierung im Netz ist längst nicht mehr nur ein Problem von Einzelnen, die in dunklen Foren abhängen. Sie ist Massenphänomen geworden – und die großen sozialen Medien sind zur Fabrik für Extremisten mutiert. Was Sicherheitsbeamte vor fünf Jahren noch als Randphänomen beschrieben hätten, ist heute Alltag auf TikTok, Telegram und X: algorithmengesteuerte Echokammern, in denen Verschwörungstheorien gedeihen, Hassbotschaften viral gehen und der Übergang vom Online-Extremisten zum politisch motivierten Gewalttäter fließend verläuft.

Die Maschine der Radikalisierung läuft auf Hochtouren

Der Bundeskriminalamt registriert derzeit eine beunruhigende Entwicklung: Die Zahl der sogenannten „Online-First-Radikalisierten" – Menschen, die primär durch soziale Medien in extremistische Milieus geraten – hat sich in den vergangenen drei Jahren verdoppelt. Das zeigt die aktuelle BKA-Lagebild-Analyse, die ZenNews24 vorliegt. Besonders betroffen sind Jugendliche und junge Erwachsene zwischen 14 und 25 Jahren. Sie nutzen diese Plattformen nicht mehr nur zur Unterhaltung, sondern als primäre Informationsquelle – mit fatalen Folgen.

Das Phänomen ist kein deutsches Alleinstellungsmerkmal. Doch die Bundesrepublik, mit ihrer Geschichte von Extremismus und ihrem entsprechenden Rechtsbewusstsein, trifft die Welle mit besonderer Wucht. Der Grund liegt in der toxischen Mischung aus technologischer Sophistication, politischer Polarisierung und dem Zusammenbruch klassischer Vermittlungsinstanzen wie Familie, Schule und lokale Gemeinschaften.

Wie die Algorithmen Extremisten hervorbringen

Das Geschäftsmodell der großen Tech-Unternehmen basiert auf Aufmerksamkeit. Je mehr Zeit ein Nutzer auf der Plattform verbringt, desto mehr Werbung kann verkauft werden. Der Algorithmus wird darauf trainiert, das Content zu priorisieren, das maximale Engagement erzeugt – unabhängig davon, ob es wahr ist oder Gewalt befördert. Extremistische Inhalte funktionieren dabei extrem gut: Sie sind emotional aufgeladen, sie geben einfache Antworten auf komplexe Fragen, sie bieten Zugehörigkeit und Identität.

Ein User könnte damit beginnen, sich ein Video über ökonomische Unsicherheit anzusehen – vollkommen legitim. Der Algorithmus schlägt dann ähnliche Videos vor. Das nächste könnte bereits subtil Schuldige ausmachen: Migranten, „das System", die Eliten. Nach wenigen Wochen hat dieser Nutzer ein täglich aktualisiertes Weltbild konsumiert, in dem eine kleine Gruppe von Bösen Millionen unschuldiger Menschen unterdrückt. Die Radikalisierung war nicht das Ziel des Algorithmuses – aber sein Nebenprodukt.

Dies funktioniert besonders wirksam bei Menschen in Krisen. Die Pandemie, die wirtschaftliche Unsicherheit, die politischen Umbrüche der vergangenen Jahre – sie alle haben ein Vakuum von Vertrauensfähigkeit hinterlassen. Wenn Institutionen scheitern, die Medien polarisiert wirken und traditionelle Orientierungspunkte bröckeln, greifen Menschen nach einfachen Erklärungen. Das Internet liefert sie in Echtzeit, 24/7, personalisiert auf die eigenen Zweifel zugeschnitten.

Die Radikalisierungspfade unterscheiden sich dabei nach Plattform. Auf TikTok dominiert das emotionale, schnelllebige Format: 60-sekündige Videos, die Angst und Wut triggern. Die Plattform wird besonders von Teenagern dominiert, deren Gehirne noch nicht vollständig ausgeprägte kritische Urteilsfähigkeit haben. Auf Telegram funktioniert es anders: Hier gibt es geschlossene Gruppen und Kanäle, in denen extremistische Ideologie konzentriert und gefestigt wird. Der Messenger-Charakter schafft Illusion von Privatheit und Exklusivität. Auf X ist es die Kombination aus Sichtbarkeit und Zustimmung durch Gleichgesinnte – ein Like von einem verifizierten Konto kann einen lokalen Extremisten plötzlich als Teil einer globalen Bewegung fühlen lassen.

Die politische Lähmung in der Krise

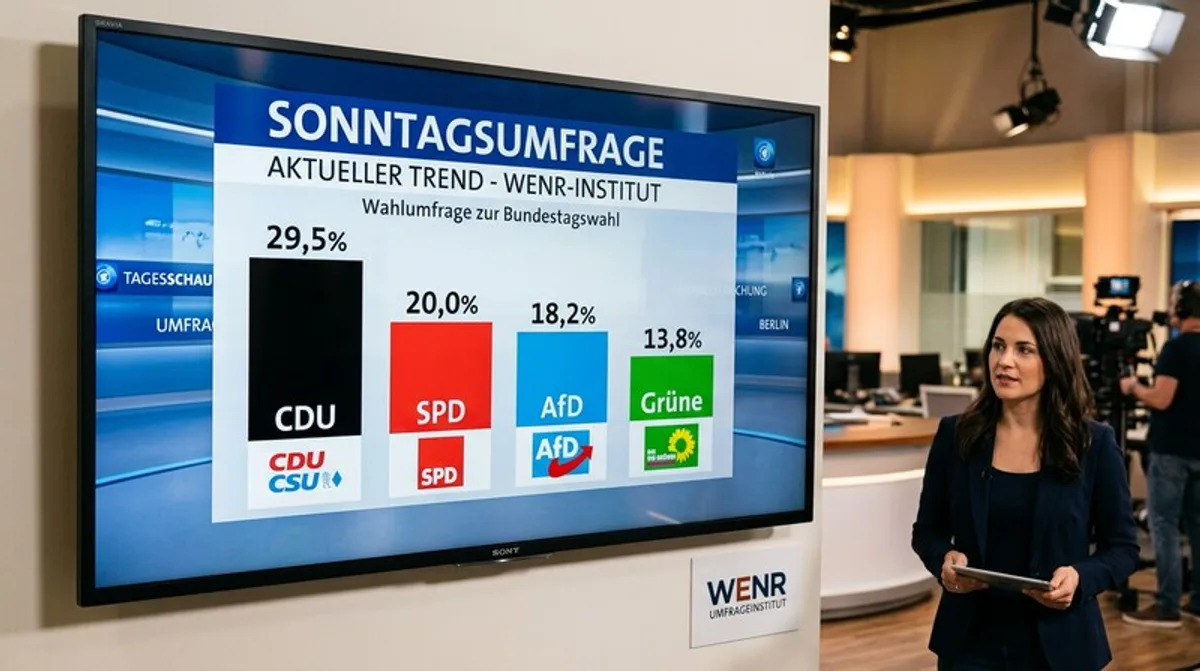

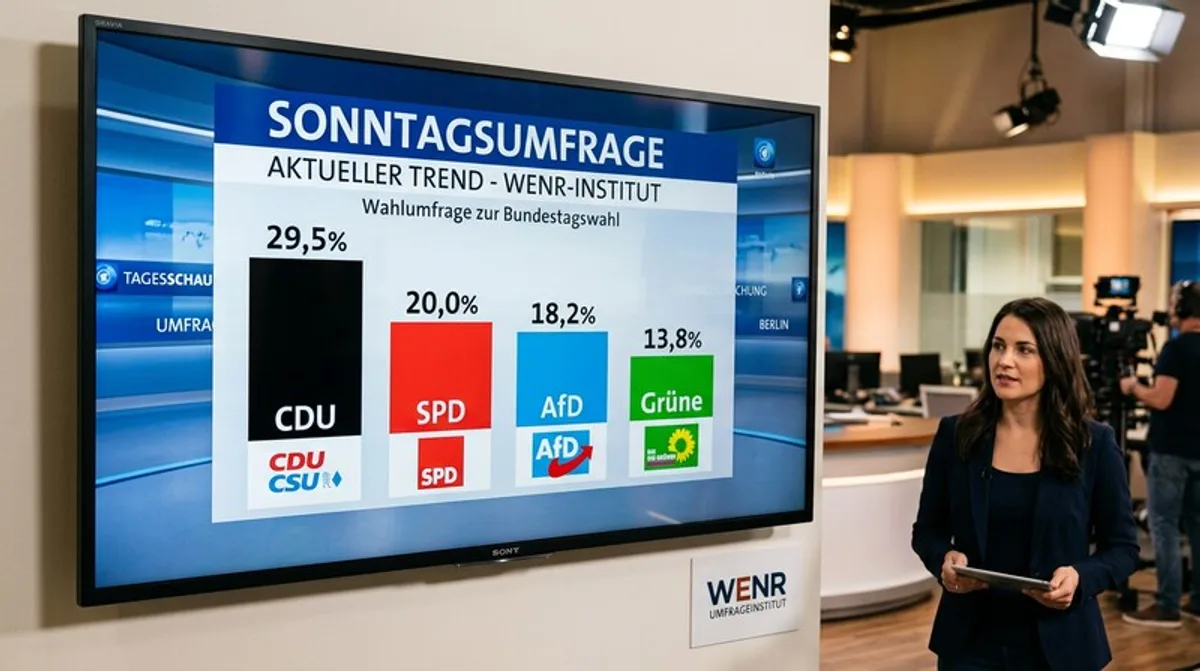

Während Extremisten im Netz florieren, debattiert die deutsche Politiklandschaft immer noch. Die CDU/CSU unter Friedrich Merz' Führung hat seit Jahren gefordert, härter gegen extremistische Plattformen vorzugehen, sieht aber auch Bedenken bezüglich Zensur und Meinungsfreiheit. Die Partei pocht auf Preaserved-Verantwortung durch die Betreiber, nicht durch den Staat.

Die SPD, derzeit in schwieriger Neuaufstellung nach dem Scholz-Kapitel, hat traditionell eine liberalere Haltung zu Plattformfreiheit, bewegt sich aber angesichts der Zahlen schrittweise zu strengerer Regulierung. Justizminister Marco Buschmann (FDP) – noch ein Akteur, obwohl die Partei 2025 unter fünf Prozent scheiterte – hatte sich lange gegen weitreichende Plattformverantwortung gewehrt. Die Grünen fordern seit Jahren ein neues Gesetz, das den absurden Zustand beendet, dass Privatkonzerne über Redefreiheit entscheiden, ohne öffentliche Verantwortung zu tragen.

Fraktionspositionen: CDU/CSU: Plattformverantwortung durch Betreiber, härtere Moderationsstandards, staatliche Kontrollmechanismen für Extremismusbekämpfung. | SPD: Schrittweise Hinwendung zu stärkerer Regulierung, Fokus auf Transparenz und Nutzerrechte, aber Bedenken gegen Überregulierung. | Grüne: Neues Gesetz zur Plattformverantwortung, strengere Haftung für Betreiber, Investition in Deradicalization-Programme. | AfD: Kritik an „Zensur durch Links-Grüne", Opposition gegen stärkere Moderationsvorgaben; gleichzeitig selbst intensive Nutzerin von Radikalisierungsplattformen. | BSW: Skeptis gegenüber Big Tech, Forderung nach dezentralisierten Alternativen, Warnung vor Überwachung im Namen der Sicherheit.

Die Realität ist, dass die deutsche Regierungsstruktur denkbar schlecht ausgestattet ist, um schnell und effektiv auf globale Plattformprobleme zu reagieren. Der Bundestag verhandelt, während die Radikalisierung weiterläuft. Es ist ein klassisches Governance-Versagen.

Die Zahlen: Wo die Radikalisierung stattfindet

| Plattform | Geschätzte Nutzer (Deutschland) | Radikalisierungspotenzial (BKA-Einstufung) | Primäres Extremismus-Spektrum |

|---|---|---|---|

| TikTok | 13,2 Millionen (v.a. unter 30) | Sehr hoch (Algorithmus-getrieben) | Rechtsextremismus, Verschwörungstheorien, Islamismus |

| Telegram | 8,7 Millionen aktiv | Extrem hoch (Echokammern) | Alle Spektren: von Q-Anon bis zum Islamismus |

| X (ehem. Twitter) | 6,4 Millionen aktiv | Hoch (dezentral, aber viral) | Rechtsextremismus, Anti-Regierungsinhalte, Hassbotschaften |

| YouTube | 41 Millionen Nutzer | Mittel bis hoch (Mainstream + Nischen) | Langform-Propagandas, ideologische Schulung |

| Instagram/Meta | 24 Millionen Nutzer | Mittel (Zielgruppennischen) | Bildästhetik-getriebener Extremismus (Symbole, Lifestyle) |

Quelle: Bundeskriminalamt, BfV (Bundesamt für Verfassungsschutz) – Lagebild 2026, teilweise veröffentlicht

Was diese Zahlen nicht erfassen: Die Dunkelziffer ist enorm. Viele Radikalisierungsprozesse finden in privaten Gruppen statt, sind für externe Beobachter unsichtbar. Das BKA schätzt, dass die erfassten Zahlen nur 30-40 Prozent der Realität abbilden.

Fallbeispiele: Von der Echokammer zur Gewalt

Die Sicherheitsbeamten haben längst dokumentiert, wie der Übergang funktioniert. Ein Beispiel aus Baden-Württemberg: Ein 19-jähriger begann mit COVID-Kritik auf TikTok. Der Algorithmus führte ihn zu Kanälen, die diese Kritik mit Eliten-Verschwörungen verbanden. Nach sechs Wochen folgte er Hunderten Konten, die eine globale jüdische Verschwörung propagierten. Nach drei Monaten war er Mitglied in mehreren Telegram-Gruppen mit explizit gewalttätigen Inhalten. Er hätte Opfer werden können oder Täter. Ein Glücksfall: Ein Schulberater erkannte Veränderungen und leitete eine Interventionsmassnahme ein.

Das sind nicht Einzelfälle. Das Bundesamt für Verfassungsschutz dokumentiert derzeit etwa 4.500 Personen in der Kategorie „Online-motivierte Gewalttäter", ein Anstieg von über 60 Prozent seit 2022. Nicht alle werden zu Attentätern – aber genug. Die Attentate von Halle (2019), Hanau (2020) und die geplante Aktion der „Reichsbürger" 2022 wurden alle durch Online-Radikalisierung katalysiert.

Was der Staat (nicht) tut

Die Bundesregierung hat erkannt, dass etwas geschehen muss. Das BKA hat ein neues Referat für „Digitale Extremismusbekämpfung" etabliert. Das BfV führt gezielte Deradikalisierungsprogramme durch. Mehrere Bundesländer haben spezialisierte Teams aufgebaut. Es sind Tropfen auf einem heißen Stein.

Das zentrale Problem: Es gibt keine tragfähige Gesetzgebung zur Plattformverantwortung auf Bundesebene, die über das bisherige NetzDG (Netzwerkdurchsetzungsgesetz) von 2017 hinausgeht. Das NetzDG verpflichtet Plattformen zwar zur Löschung illegaler Inhalte innerhalb bestimmter Fristen, aber es ist zahnlos. Die Bußgelder sind niedrig, die Compliance ist lax, und die Plattformen haben primär Anreiz, zu tun, was am wenigsten kostet.

Die neue Legislatur müsste einen echten Gesetzentwurf vorlegen, der Plattformen zu Transparenz verpflichtet, Algorithmen einer Überprüfung unterwirft und für Schäden durch algorithmisch beförderte Extremisierung haftbar macht. Das würde auch bedeuten, dass YouTube-Videos nicht nur gelöscht werden, sondern dass dokumentiert wird, wer sah, was der Algorithmus zeigte, und mit welchen Konsequenzen.

Doch politisch ist die Lage verkorkst. Tech-Unternehmen spenden großzügig an Parteien. Der Grundsatz der Meinungsfreiheit ist hochsensibel in Deutschland, besonders angesichts der NS-Geschichte. Und viele Politiker selbst sind Social-Media-abhängig – sie verstehen nicht, dass die Plattformen, die ihnen Reichweite geben, gleichzeitig Demokratie untergraben.

Besonders absurd: Die AfD, die von der extremistischen Online-Mobilisierung profitiert, ist gleichzeitig vehement gegen Plattformmoderation. Die Partei betreibt selbst massive Desinformationskampagnen auf Telegram und X. Friedrich Merz' CDU wiederum hat sich nach rechts bewegt, was teilweise auch eine Reaktion auf die mediale Rechtsdominanz ist – ein Teufelskreis.

Internationale Perspektive: Was andere machen

Die Europäische Union ist mit dem Digital Services Act (DSA) bereits weiter als Deutschland allein. Der DSA verpflichtet große Plattformen zu Transparenz, Moderation und Forschungszugang. Es ist nicht perfekt, aber es ist ein Anfang. Die Schweiz, Österreich, Frankreich und Skandinavien haben teilweise noch strengere Regelungen.

Die USA sind dagegen ein Desaster: Section 230 des Communications Decency Act macht Plattformen praktisch haftungsfrei. Das Ergebnis ist, dass die USA zum Exporteur radikalisierender Inhalte geworden sind. Inhalte, die auf US-amerikanischen Plattformen entfernt