KI im Gerichtssaal: Wenn Anwälte mit Algorithmen arbeiten

Harvey AI, Lexis+AI — deutsche Kanzleien und ihre Erfahrungen

Rund 80 Prozent der Arbeitszeit von Anwälten entfallen auf das Lesen und Analysieren von Dokumenten — das ist die Grundlage, auf der KI-Systeme wie Harvey AI oder Lexis+ AI gerade die Rechtsbranche umzukrempeln versuchen. Deutsche Kanzleien beobachten den Trend mit wachsendem Interesse, aber auch mit einer gesunden Portion Skepsis.

Kerndaten: Der globale Markt für Legal-Tech-Lösungen wächst laut IDC derzeit mit zweistelligen Jahresraten. In Deutschland nutzen laut Bitkom bereits rund ein Drittel der befragten Kanzleien KI-gestützte Tools für zumindest Teilbereiche ihrer Arbeit. Harvey AI, finanziert unter anderem von OpenAI-nahen Investoren, soll mittlerweile mit über hundert Großkanzleien weltweit zusammenarbeiten. Lexis+ AI, das Produkt des Datenbankgiganten LexisNexis, integriert generative KI direkt in eine der umfangreichsten juristischen Datenbanken der Welt. Die DSGVO und das anstehende EU-AI-Act-Regelwerk gelten als zentrale Hürden für den breiten Einsatz in Europa.

Was Legal AI eigentlich macht — und was nicht

Wer KI im Gerichtssaal erwartet, wird zunächst enttäuscht. Die Systeme, die gerade in der Rechtsbranche diskutiert werden, arbeiten im Hintergrund: Sie lesen Verträge, suchen nach Präzedenzfällen, fassen lange Schriftsätze zusammen und schlagen Formulierungen vor. Der Begriff „Generative KI" beschreibt dabei Modelle, die auf Basis riesiger Textmengen trainiert wurden und selbstständig kohärente, kontextbezogene Antworten produzieren können — ähnlich wie ein sehr belesener Assistent, der aber keine eigene Urteilsfähigkeit besitzt.

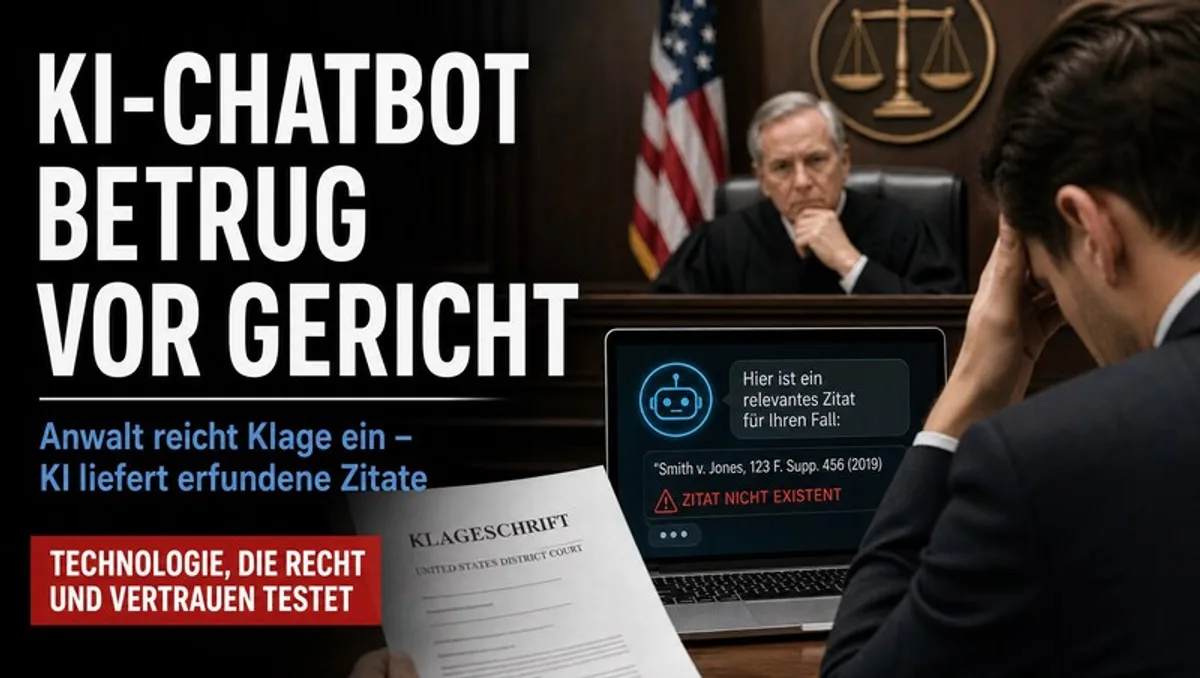

Das ist der entscheidende Unterschied, den Kanzleien verstehen müssen: Diese Systeme halluzinieren. Der Fachbegriff bezeichnet das Phänomen, dass KI-Modelle mit großer Überzeugung falsche Informationen produzieren — erfundene Urteile, fehlerhafte Paragraphen, fiktive Quellen. Ein US-amerikanischer Anwalt musste vor einigen Jahren genau das schmerzhaft vor Gericht erklären: Er hatte ChatGPT-generierte Zitate verwendet, die schlicht nicht existierten. Der Fall machte international Schlagzeilen und beschäftigt die Legal-Tech-Branche bis heute.

Genau hier setzen spezialisierte Systeme wie Harvey AI oder Lexis+ AI an. Sie versprechen, dieses Risiko durch domänenspezifisches Training und die Anbindung an verifizierte Rechtsdatenbanken zu reduzieren. Ob das Versprechen hält, ist eine der zentralen Fragen, mit denen deutsche Kanzleien derzeit ringen.

Harvey AI vs. Lexis+ AI: Zwei Ansätze, ein Ziel

Harvey AI positioniert sich als KI-Assistent, der direkt in die Arbeitsabläufe von Anwaltskanzleien integriert wird. Das System basiert auf großen Sprachmodellen, die zusätzlich auf juristisches Material spezialisiert trainiert wurden. Nutzer können Verträge hochladen, Fragen stellen, Entwürfe generieren lassen und Due-Diligence-Prozesse beschleunigen — also jene aufwändigen Prüfprozesse, bei denen etwa vor Unternehmenskäufen Tausende von Dokumenten gesichtet werden müssen.

Lexis+ AI geht einen anderen Weg: Hier ist die KI unmittelbar mit der LexisNexis-Datenbank verknüpft, die Millionen von Gerichtsentscheidungen, Gesetzen und Fachartikeln enthält. Der Vorteil liegt auf der Hand — die Quellenangaben lassen sich direkt zurückverfolgen. Das System antwortet nicht nur, sondern zeigt an, aus welchem Urteil oder welchem Gesetzestext eine Aussage stammt. Das adressiert das Halluzinationsproblem zumindest teilweise, löst es aber nicht vollständig.

| Kriterium | Harvey AI | Lexis+ AI |

|---|---|---|

| Technologiebasis | Spezialisiertes LLM (Large Language Model), OpenAI-Infrastruktur | Generative KI integriert in LexisNexis-Datenbank |

| Kernfunktion | Vertragsprüfung, Due Diligence, Dokumentenanalyse, Drafting | Fallrecherche, Zitatennachweis, Zusammenfassungen, Rechtsanalyse |

| Quellenverifizierung | Eingeschränkt, modellabhängig | Direkte Verlinkung zur Primärquelle in der Datenbank |

| Datenschutz / DSGVO | Vertragliche Zusicherungen, US-Infrastruktur kritisch bewertet | Europäische Serveroptionen teilweise verfügbar |

| Zielgruppe | Große internationale Wirtschaftskanzleien | Breites Spektrum, auch mittelgroße Kanzleien |

| Sprachunterstützung Deutsch | Eingeschränkt, Schwerpunkt Englisch | Deutlich ausgebaut, auch deutsches Recht abgedeckt |

| Preismodell | Enterprise-Lizenzen, keine öffentlichen Preise | Abonnementbasiert, Staffelpreise nach Nutzerzahl |

Deutsche Kanzleien: Zwischen Neugier und Zurückhaltung

Wer deutsche Anwälte nach ihrer Erfahrung mit diesen Systemen fragt, hört vor allem eines: Vorsicht. Das hat mehrere Gründe. Erstens ist das deutsche Rechtssystem stark kodifiziert — es basiert nicht wie das angloamerikanische Common Law primär auf Präzedenzfällen, sondern auf einem dichten Geflecht aus Gesetzen, Verordnungen und Kommentarliteratur. KI-Systeme, die im englischsprachigen Raum trainiert wurden, stoßen hier schnell an Grenzen.

Zweitens wiegt die Datenschutzfrage schwer. Wenn Mandantendaten in ein KI-System hochgeladen werden, stellt sich sofort die Frage: Wo werden diese Daten verarbeitet? Auf welchen Servern? Wer hat Zugriff? Die DSGVO stellt klare Anforderungen — und der Verdacht, dass Daten auf US-amerikanischen Servern landen könnten, ist für viele Kanzleien ein K.-o.-Kriterium. Laut Bitkom ist der Datenschutz das meistgenannte Hindernis bei der Einführung von KI in deutschen Unternehmen — und Rechtsanwaltskanzleien mit ihrer Verschwiegenheitspflicht sind hier besonders exponiert.

Erfahrungsberichte aus der Praxis

Einige Großkanzleien in Deutschland testen Legal-AI-Systeme intern seit mehreren Monaten. Die Rückmeldungen, die öffentlich zugänglich sind, zeichnen ein differenziertes Bild. Für standardisierte Aufgaben — das Herausfiltern relevanter Klauseln aus langen Verträgen, das Erstellen erster Zusammenfassungen, das Prüfen auf formal vollständige Angaben — wird die Zeitersparnis als erheblich beschrieben. Stunden werden zu Minuten.

Kritischer wird es bei komplexeren Analysen. Die Frage, ob eine bestimmte Vertragsklausel in einem deutschen Kontext rechtlich Bestand hat, erfordert eine juristische Urteilsfähigkeit, die aktuelle KI-Systeme nicht besitzen. Sie können Muster erkennen, ähnliche Formulierungen aus ihrer Trainingsbasis vorschlagen und Risiken flaggen — aber die finale Einschätzung muss der Anwalt treffen, und zwar mit vollem Bewusstsein dafür, dass das System Fehler produzieren kann, die äußerlich überzeugend klingen.

Gartner prognostiziert, dass bis zum Ende dieses Jahrzehnts ein Großteil der Legal-Tech-Ausgaben in KI-gestützte Automatisierung fließen wird. Gleichzeitig warnen Analysten, dass der tatsächliche produktive Einsatz hinter den Marketingversprechen zurückbleiben werde — ein Muster, das sich bei vielen Technologiewellen wiederholt hat.

Der EU AI Act als Spielveränderer

Für den deutschen und europäischen Markt kommt ein weiterer regulatorischer Faktor hinzu: der EU AI Act, das weltweit erste umfassende KI-Regulierungswerk. Es klassifiziert KI-Systeme nach Risikoklassen. Systeme, die in der Rechtspflege eingesetzt werden und Empfehlungen oder Entscheidungen beeinflussen, könnten als hochriskant eingestuft werden — mit entsprechend strengen Anforderungen an Transparenz, Dokumentation und menschliche Aufsicht.

Das bedeutet: Kanzleien, die jetzt in Legal AI investieren, müssen sicherstellen, dass ihre Systeme nicht nur heute funktionieren, sondern auch den kommenden Compliance-Anforderungen standhalten. Anbieter, die das ernst nehmen, bauen bereits Audit-Trails ein — also lückenlose Protokolle darüber, welche KI-Ausgabe wann von welchem Anwalt überprüft und freigegeben wurde. Das ist auch deshalb wichtig, weil die berufsrechtliche Verantwortung klar beim Anwalt verbleibt, nicht beim Algorithmus.

Ähnliche Mechanismen der algorithmischen Einflussnahme, bei denen undurchsichtige Systeme im Hintergrund Empfehlungen produzieren, beobachten wir auch in anderen Bereichen: Wer verstehen will, wie KI-Algorithmen soziale Netzwerke und unsere Informationswahrnehmung steuern, erkennt schnell das übergreifende Muster — Effizienzversprechen auf der einen, Kontrollverlust auf der anderen Seite.

Was auf dem Spiel steht: Vertrauen und Haftung

Die juristische Branche lebt von Vertrauen. Wenn ein Mandant einer Kanzlei ein komplexes Unternehmensgeschäft anvertraut, erwartet er nicht nur Fachkompetenz, sondern auch die Gewissheit, dass seine Daten und Interessen geschützt sind. KI verändert diese Gleichung auf eine Weise, die noch nicht abschließend bewertet ist.

Statista-Daten zeigen, dass das Vertrauen der deutschen Bevölkerung in KI-Systeme für sensible Entscheidungsprozesse — Gesundheit, Finanzen, Recht — deutlich geringer ist als in technologieaffinen Märkten wie den USA oder Südkorea. Das ist für die Kanzleien relevant: Sie müssen nicht nur intern entscheiden, ob sie KI einsetzen wollen, sondern auch extern kommunizieren, wie und in welchem Umfang das geschieht.

Haftungsfragen sind dabei noch weitgehend ungeklärt. Wenn ein KI-System eine falsche Vertragsklausel übersieht und daraus ein Schaden entsteht — wer haftet? Der Anwalt, der das Ergebnis ungeprüft übernommen hat? Die Kanzlei? Der KI-Anbieter? Die Antwort ist juristisch komplex und dürfte die Gerichte in den kommenden Jahren beschäftigen.

Die Parallelen zu anderen Branchen, in denen Algorithmen tiefgreifende Entscheidungen beeinflussen, sind unübersehbar. In der Telefonkommunikation etwa drängen automatisierte Systeme in Bereiche vor, die lange als menschliche Domäne galten — ein Phänomen, das sich auch im Recht abzeichnet: KI im Call Center verändert bereits heute die Arbeitswelt grundlegend, und die Lehren daraus sind für das Legal-Tech-Feld direkt übertragbar.

Auch die Sicherheitsdimension darf nicht ausgeblendet werden. Juristische Datenbanken und Kanzleisysteme sind attraktive Ziele für Cyberkriminalität — sensible Mandantendaten, Geschäftsgeheimnisse, Verhandlungsstrategien. KI-gestützte Cyberkriminalität wird dabei immer raffinierter, was die Sicherheitsanforderungen an Legal-AI-Plattformen weiter verschärft.

Mittelständische Kanzleien: Das übersehene Problem

Die Debatte um Harvey AI und Lexis+ AI dreht sich überwiegend um Großkanzleien mit entsprechenden Budgets und IT-Ressourcen. Der deutsche Rechtsmarkt besteht jedoch zu großen Teilen aus mittelständischen und kleinen Kanzleien — Einzelanwälte, Sozietäten mit wenigen Partnern, regionale Spezialisten. Für sie sind Enterprise-Lizenzen im fünfstelligen Bereich schlicht keine realistische Option.

Hier entstehen mittlerweile günstigere Alternativen: DSGVO-konforme europäische Anbieter, die auf Open-Source-Modellen basieren und juristisches Wissen für spezifische Rechtsordnungen aufbereiten. Der Markt ist im Entstehen, die Qualität variiert erheblich. IDC erwartet in diesem Segment in den nächsten Jahren eine Konsolidierungswelle, ähnlich wie sie in anderen Software-Märkten nach einer ersten Experimentierphase regelmäßig eintritt.

Bemerkenswert ist auch, dass die Nutzung von KI im Rechtsbereich weit über reine Effizienzfragen hinausgeht und gesellschaftliche Konsequenzen hat: Wenn Anwälte günstiger und schneller arbeiten können, verändert das potenziell den Zugang zum Recht — ein Argument, das sowohl als Chance als auch als Risiko diskutiert wird. Günstiger könnte bedeuten, dass mehr Menschen rechtliche Beratung in Anspruch nehmen können. Es könnte aber auch bedeuten, dass der Druck auf Honorare steigt und kleinere Kanzleien aus dem Markt gedrängt werden. Ähnliche Fragen nach algorithmischem Einfluss auf individuelle Entscheidungen stellen sich auch, wenn man betrachtet, wie KI in der personalisierten Werbung tiefe Einblicke in persönliche Daten nutzt — der Unterschied liegt lediglich im Anwendungsfeld.

Und schließlich: Die Frage, welche menschlichen Tätigkeiten durch Algorithmen ersetzt oder ergänzt werden sollten, ist keine rein technische. Sie ist auch eine gesellschaftliche. Für sensible Bereiche wie das Recht, aber auch die mentale Gesundheitsversorgung, wo KI-Apps in die therapeutische Lücke drängen, gilt dasselbe Prinzip: Technologie kann unterstützen, aber Verantwortung und Urteilsvermögen bleiben menschliche Aufgaben — zumindest nach aktuellem Rechts- und Technikstand.

Fazit ohne Euphorie

Legal AI ist keine Zukunftstechnologie mehr — sie ist in einigen deutschen Großkanzleien bereits im Testeinsatz. Aber sie ist auch keine ausgereifte, risikofreie Lösung. Die Systeme, die derzeit auf dem Markt sind, bieten echte Effizienzgewinne bei klar definierten, repetitiven Aufgaben. Sie versagen oder werden riskant, wenn juristische Urteilsfähigkeit, kulturelle Kontextkenntnis oder tiefe Systemkenntnis gefragt ist.

Die Kanzleien, die diesen Unterschied verstehen und ihre Mitarbeiter entsprechend schulen, werden von der Technologie profitieren. Jene, die KI als Abkürzung für Verantwortung missverstehen, riskieren nicht nur schlechte Arbeitsergebnisse — sondern auch Haftungsrisiken und Reputationsschäden. Der Algorithmus sitzt nicht auf der Anklagebank. Der Anwalt tut es.