Deepfake-Identitätsdiebstahl: Wenn Ihr Gesicht gegen Sie arbeitet

Biometrische Sicherheit, Liveness Detection, Gegenmaßnahmen

Rund 500 Millionen Deepfake-Videos kursieren laut Schätzungen des Sicherheitsanalyseunternehmens Deeptrace derzeit im Netz — und ein wachsender Teil davon zielt nicht auf politische Manipulation oder Ruhm, sondern auf etwas weitaus Persönlicheres: Ihre Identität. Deepfake-Identitätsdiebstahl hat sich von einem Science-Fiction-Szenario zu einer realen, wirtschaftlich motivierten Bedrohung entwickelt, die biometrische Sicherheitssysteme weltweit herausfordert.

Wenn das Gesicht zur Angriffsfläche wird

Biometrische Authentifizierung galt lange als Goldstandard der digitalen Sicherheit. Ein Fingerabdruck lässt sich nicht so einfach stehlen wie ein Passwort, das Gesicht nicht kopieren wie eine PIN — so lautete die Versprechen der Branche. Diese Annahme ist heute grundlegend erschüttert. Moderne KI-Systeme, trainiert auf öffentlich verfügbaren Bilddaten aus sozialen Netzwerken, sind in der Lage, aus einem einzigen Foto ein täuschend echtes Bewegtbild einer Person zu erzeugen. Hochauflösende Gesichtsmodelle, die sogenannten Generative Adversarial Networks (GANs) nutzen — also zwei konkurrierende KI-Systeme, von denen eine Fälschungen erstellt und die andere diese zu entlarven versucht, bis das Ergebnis perfekt erscheint — haben die Qualität von Deepfakes in kürzester Zeit auf ein Niveau gehoben, das selbst geschulte Augen täuscht.

Das Bedrohungsszenario ist konkret: Kriminelle laden Fotos eines Opfers aus sozialen Medien, erzeugen daraus ein synthetisches Video, und täuschen damit das Gesichtserkennungssystem einer Bank, eines Behördenportals oder einer Identitätsverifizierungsplattform. Der Angreifer öffnet Konten, beantragt Kredite oder verschafft sich Zugang zu sensiblen Systemen — im Namen einer Person, die davon nichts ahnt. Laut einer Analyse von Sumsub, einem Anbieter im Bereich Identitätsprüfung, haben sich Deepfake-basierte Angriffe auf Onboarding-Systeme innerhalb eines einzigen Jahres vervielfacht (Quelle: Sumsub Identity Fraud Report).

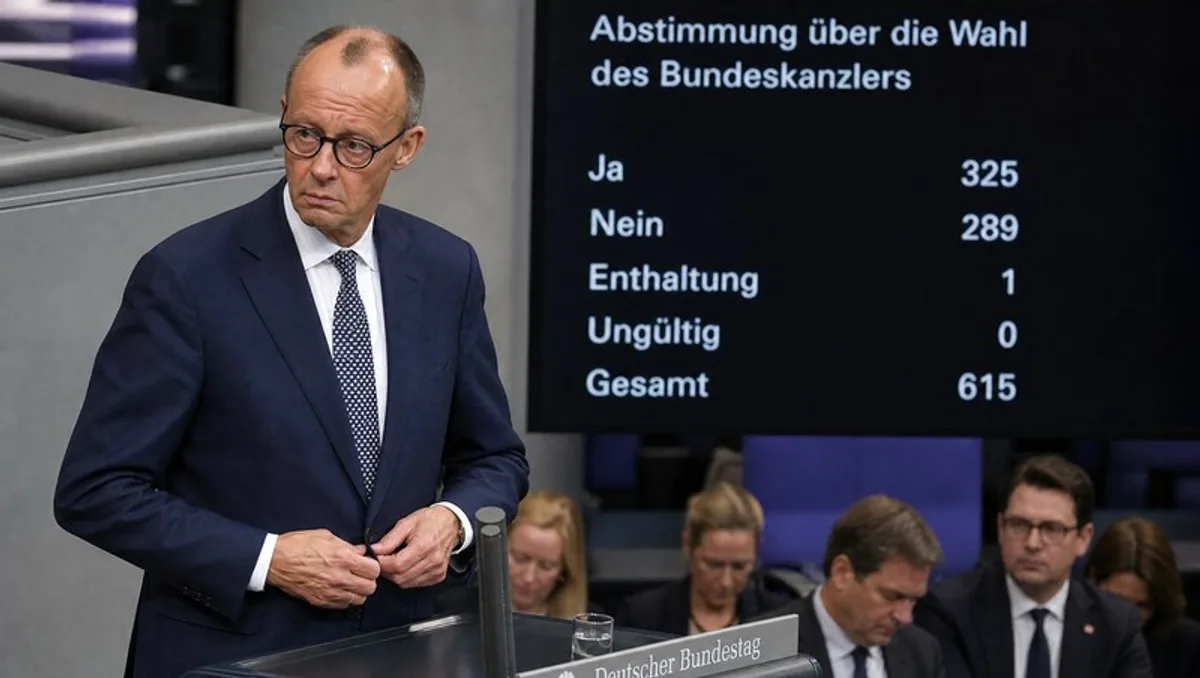

Die politische Dimension dieser Technologie ist dabei bereits gut dokumentiert: Wie Deepfakes im Bundestagswahlkampf eingesetzt wurden und das BKA vor massiver Desinformation warnte, zeigt, wie weit die Manipulationsmöglichkeiten bereits reichen. Doch während politische Deepfakes auf Öffentlichkeitswirkung abzielen, ist der Identitätsdiebstahl durch synthetische Biometrie ein stiller, gezielter und oft erst Monate später bemerkter Angriff auf Privatpersonen.

Kerndaten: Deepfake-Betrug wächst rasant — Sumsub verzeichnete einen Anstieg von Deepfake-Angriffen auf Identitätsprüfungssysteme um über 700 Prozent im Jahresvergleich. Gartner prognostiziert, dass bis zur Mitte dieses Jahrzehnts 30 Prozent aller Identitätsprüfungen ohne Liveness-Detection-Technologie kompromittierbar sein werden. IDC schätzt den globalen Markt für biometrische Sicherheitslösungen auf über 50 Milliarden US-Dollar — mit zweistelligen jährlichen Wachstumsraten. Bitkom meldet, dass in Deutschland aktuell rund 60 Prozent der Unternehmen biometrische Authentifizierung einsetzen oder planen, ohne dabei systematisch auf KI-Gegenmaßnahmen zu setzen. (Quellen: Sumsub, Gartner, IDC, Bitkom)

Liveness Detection: Die erste Verteidigungslinie

Die unmittelbarste technische Antwort auf synthetische Gesichter lautet Liveness Detection — zu Deutsch: die Erkennung, ob das gegenüber einem Kamerasystem präsentierte Gesicht tatsächlich einem lebenden Menschen gehört, der physisch anwesend ist, oder ob es sich um eine digitale Fälschung handelt. Dabei unterscheiden Sicherheitsexperten zwei grundlegende Ansätze.

Aktive versus passive Liveness Detection

Bei der aktiven Liveness Detection wird der Nutzer aufgefordert, eine bestimmte Handlung auszuführen: den Kopf drehen, blinzeln, lächeln oder eine zufällig angezeigte Zifferfolge sprechen. Das System prüft, ob die Reaktion einer echten menschlichen Bewegung entspricht. Der Nachteil: Angreifer kennen diese Verfahren und trainieren ihre Deepfake-Modelle darauf, auch Challenge-Response-Szenarien zu bestehen — sogenannte Video-Injection-Angriffe, bei denen ein vorab generiertes synthetisches Video direkt in den Kamerastream eingespeist wird, umgehen aktive Prüfungen zunehmend.

Die passive Liveness Detection arbeitet dagegen unsichtbar im Hintergrund. Sie analysiert Texturanomalien im Bild, Mikroreflexionen auf der Haut, die subtile dreidimensionale Struktur eines echten Gesichts sowie Artefakte, die durch Komprimierungsalgorithmen bei der Generierung synthetischer Medien entstehen. Dieser Ansatz ist für Nutzer reibungslos, stellt aber höhere Anforderungen an die KI-Modelle, die hinter dem System stehen. Laut Gartner werden passive Methoden mittelfristig die aktiven Verfahren als Industriestandard ablösen, da sie schwerer zu umgehen sind und die Nutzererfahrung nicht beeinträchtigen (Quelle: Gartner Hype Cycle for Digital Identity).

Multimodale Biometrie als Systemantwort

Ein weiterer Ansatz ist die Kombination mehrerer biometrischer Merkmale in einem Prüfvorgang. Statt nur das Gesicht zu analysieren, werden gleichzeitig Stimmmuster, Tippverhalten auf der Tastatur, Gerätefingerabdrücke und geografische Konsistenz ausgewertet. Dieses multimodale Verfahren erhöht den Aufwand für Angreifer erheblich, da sie nicht nur ein, sondern mehrere biometrische Systeme gleichzeitig überwinden müssten. Sicherheitsforscher vom Fraunhofer-Institut für Sichere Informationstechnologie betonen, dass kein einzelnes Verfahren allein robust genug ist — erst die Kombination schafft eine belastbare Verteidigungsarchitektur (Quelle: Fraunhofer SIT).

Der Markt der Verteidiger: Wer bietet was?

Die Sicherheitsbranche reagiert auf die wachsende Bedrohung mit einer Vielzahl spezialisierter Lösungen. Ein Überblick über die wichtigsten Anbieter und Ansätze zeigt, dass der Markt noch heterogen ist — und Standards fehlen.

| Anbieter / Lösung | Ansatz | Stärken | Einschränkungen |

|---|---|---|---|

| iProov (UK) | Passive Liveness Detection, Cloud-basiert, Flashmark-Technologie | Zertifiziert für Behördenanwendungen, resistent gegen Video-Injection | Abhängigkeit von Cloud-Infrastruktur, Datenschutzfragen |

| Idemia (FR) | Multimodale Biometrie, On-Device-Verarbeitung | Lokale Datenverarbeitung, breite Behörden-Referenzen | Hohe Integrationskosten für kleinere Unternehmen |

| Veriff (EE) | KI-gestützte Dokumenten- und Gesichtsverifizierung | Schnelles Onboarding, DSGVO-konform, gut skalierbar | Weniger robust gegen hochentwickelte GAN-Angriffe |

| Sumsub (GB/CY) | Ende-zu-Ende Identitätsverifikation inkl. Deepfake-Detektion | Umfassendes Reporting, Compliance-Tools | Qualität variiert je nach Markt und Dokumententyp |

| Microsoft Azure Face API | Cloud-KI-Gesichtserkennung mit Liveness-Modul | Einfache Integration, hohe Verfügbarkeit | Datenschutzbedenken, eingeschränkte Transparenz der Modelle |

| BioID (DE) | Passive Liveness, ISO-zertifiziert, europäischer Anbieter | Starker Datenschutzfokus, DSGVO-native Architektur | Geringere globale Marktpräsenz |

Was die Tabelle zeigt: Es gibt keine universelle Lösung. Jeder Anbieter hat spezifische Stärken, die je nach Anwendungsfall — Bankwesen, Behörde, E-Commerce — unterschiedlich gewichtet werden müssen. Gartner empfiehlt Unternehmen, bei der Anbieterwahl explizit nach ISO-30107-3-Zertifizierung zu fragen, dem internationalen Standard für Presentation-Attack-Detection (Quelle: Gartner Security Research).

Was Nutzer jetzt tun können — und was nicht

Die unbequeme Wahrheit für Privatpersonen: Der individuelle Handlungsspielraum ist begrenzt. Wer Fotos auf sozialen Netzwerken veröffentlicht, stellt potenziell das Rohmaterial für synthetische Identitäten bereit. Ein vollständiger Rückzug aus dem digitalen Leben ist weder realistisch noch die richtige Antwort. Sinnvoller ist ein bewussterer Umgang mit biometrischen Daten.

Konkret bedeutet das: Mehrstufige Authentifizierung aktivieren, wann immer möglich — idealerweise in Kombination mit einem Hardware-Token wie einem FIDO2-Sicherheitsschlüssel, der physisch vorhanden sein muss und nicht per Deepfake ersetzt werden kann. Bei Banken und Behördenportalen aktiv nachfragen, welche Liveness-Detection-Verfahren eingesetzt werden. Und: Verdächtige Kontoeröffnungen oder Kreditanfragen im eigenen Namen frühzeitig durch regelmäßige Schufa-Abfragen oder Kreditüberwachungsdienste erkennen.

Auf regulatorischer Ebene bewegt sich Europa. Das EU-weite Verbot sexualisierter Deepfakes ist ein erster Schritt, adressiert aber nur einen Teilbereich des Problems. Der EU AI Act schreibt für Hochrisikoanwendungen im Bereich Biometrie zukünftig Transparenzpflichten und technische Robustheitsstandards vor — die Umsetzung läuft jedoch noch an. Dass parallele technologische Entwicklungen das Regulierungstempo unter Druck setzen, ist auch in anderen Netzbereichen zu beobachten: Der Wandel in der Mobilfunkinfrastruktur, wie etwa die Abschaltung des 2G-Netzes durch A1 Telekom Austria, zeigt exemplarisch, wie schnell Sicherheitsannahmen technologisch überholt werden können — und wie wichtig proaktive Anpassung ist.

Die strukturelle Herausforderung: Angriff und Verteidigung im Gleichschritt

Das fundamentale Problem der Deepfake-Abwehr ist epistemischer Natur: Die Modelle, die Fälschungen erkennen sollen, werden mit denselben Trainingsdaten und ähnlichen Architekturen entwickelt wie die Modelle, die Fälschungen erzeugen. Ein Deepfake-Detektor, der heute eine Erkennungsrate von 98 Prozent hat, kann morgen von einem weiterentwickelten Generatormodell ausgehebelt werden. Dieses Katz-und-Maus-Spiel ist strukturell — und es begünstigt langfristig die Angreifer, weil der Angriff nur einmal gelingen muss, während die Verteidigung dauerhaft standhalten muss.

Statista-Daten belegen, dass der globale Schaden durch digitalen Identitätsbetrug bereits jetzt in der Größenordnung von mehreren hundert Milliarden US-Dollar jährlich liegt — mit stark steigender Tendenz (Quelle: Statista Cybercrime Report). IDC warnt, dass Unternehmen, die heute keine Deepfake-Resilienz in ihre Identitätsinfrastruktur einbauen, innerhalb von drei bis fünf Jahren mit signifikanten Compliance- und Haftungsrisiken konfrontiert sein werden (Quelle: IDC Future of Trust Survey).

Wie bei der Rolle von KI-Fakes im US-Wahlkampf deutlich wurde, entfaltet die Deepfake-Technologie ihre destabilisierende Wirkung nicht nur im Kleinen: Die Erosion des Vertrauens in digitale Identität hat systemische Folgen — für Finanzmärkte, demokratische Prozesse und gesellschaftlichen Zusammenhalt. Die technische Herausforderung ist zugleich eine politische.

Auch die Konsolidierung in der Telekommunikationsbranche, wie die Übernahme von Three durch Vodafone für fünf Milliarden Euro, verändert die Rahmenbedingungen: Größere Netzbetreiber können Sicherheitsstandards für SIM-basierte Authentifizierung flächendeckender durchsetzen — oder scheitern daran, wenn Regulierer nicht mitziehen.

Was als nächstes kommt

Die Sicherheitsforschung konzentriert sich derzeit auf drei Entwicklungslinien: Erstens die Integration kryptografischer Echtheitsnachweise direkt in Aufnahmegeräte — sogenannte Camera Attestation, bei der der Sensor beim Erfassen eines Bildes eine kryptografische Signatur erzeugt, die nachweist, dass das Bild real und unverändert ist. Initiativen wie die Content Authenticity Initiative (CAI) von Adobe und anderen arbeiten an offenen Standards dafür.

Zweitens gewinnt föderales Lernen an Bedeutung: Deepfake-Erkennungsmodelle werden dabei über viele Geräte hinweg trainiert, ohne dass sensible Bilddaten zentral zusammengeführt werden müssen — ein datenschutzkonformer Ansatz, der gleichzeitig die Datenbasis für Detektoren verbreitert.

Drittens rückt die physische Sicherheitsschicht wieder in den Fokus. Hardware-gebundene Identitätsnachweise — von der physischen ID-Karte mit NFC-Chip bis zum kryptografisch gesicherten Reisepass — sind schwerer zu fälschen als rein software-basierte Verfahren. Die EU-weite Einführung der digitalen Identitätsbrieftasche (eIDAS 2.0) setzt auf diesen Ansatz: biometrische Daten, die an ein physisches Dokument und ein zertifiziertes Gerät gebunden sind, und nicht allein in einer Cloud-Datenbank liegen.

Bis diese Systeme flächendeckend etabliert sind, bleibt das Gesicht eine angreifbare Größe. Nicht weil biometrische Sicherheit prinzipiell gescheitert ist — sondern weil sie in einer Welt eingesetzt wird, in der die Fähigkeit zur synthetischen Imitation schneller gewachsen ist als die Fähigkeit zur Erkennung. Die Antwort darauf ist nicht Panik, aber sie ist auch nicht Gleichmut. Sie ist systematische, technisch fundierte und regulatorisch flankierte Modernisierung — bevor der nächste Angriff ein Gesicht trägt, das Sie im Spiegel kennen.