KI-Haftung: Wer zahlt, wenn die KI Fehler macht?

EU-Haftungsrecht, Herstellerpflichten, Präzedenzfälle — der Rechtsrahmen

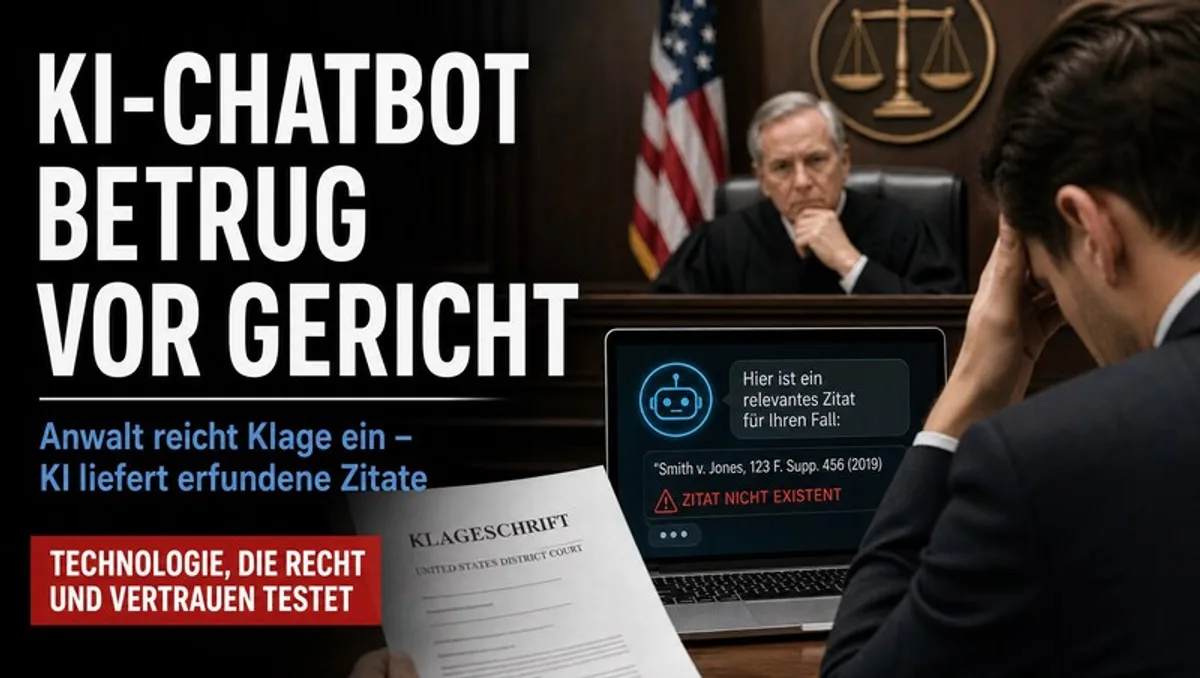

Künstliche Intelligenz trifft auf ein Rechtssystem, das noch nicht auf sie vorbereitet ist. Während Chatbots Diagnosen unterstützen, autonome Fahrzeuge Unfälle verursachen und Algorithmen über Kreditvergabe entscheiden, stellt sich eine grundlegende Frage: Wer haftet, wenn die KI Fehler macht? Die Antwort ist komplex, bisweilen unbefriedigend – und sie wird derzeit in Brüssel, Berlin und den Gerichtssälen Europas neu geschrieben.

- Der europäische Rechtsrahmen: AI Act und Produkthaftungs-Richtlinie

- Technologischer Hintergrund

Das EU-Haftungsrecht befindet sich in einer Umbruchphase. Während traditionelle Produkthaftung klar definierte Verantwortlichkeiten kennt – der Hersteller haftet für fehlerhafte Produkte –, verschwimmen diese Grenzen bei intelligenten Systemen rapide. Die KI lernt, passt sich an, verhält sich teilweise unvorhersehbar. Der Grund liegt in der Natur maschinellen Lernens: Selbst Entwickler können nicht in jedem Fall exakt erklären, warum ein System eine bestimmte Entscheidung getroffen hat. Dieses sogenannte „Black-Box-Problem" ist eine der zentralen Herausforderungen im modernen Haftungsrecht – und gleichzeitig der Kern der politischen Debatte über KI-Regulierung.

Kerndaten zur KI-Haftung: Nach einer Erhebung des Digitalverbands Bitkom planen 68 Prozent der deutschen Unternehmen, KI-Systeme in den nächsten zwei Jahren stärker einzusetzen. Gleichzeitig geben nur 34 Prozent an, mit der geltenden Rechtslage zur KI-Haftung vertraut zu sein (Quelle: Bitkom-Studie 2023). Der AI Act der Europäischen Union ist seit August 2024 in Kraft und wird schrittweise bis 2027 vollständig anwendbar. Die überarbeitete EU-Produkthaftungs-Richtlinie, die explizit KI-Systeme und digitale Produkte einschließt, trat im Dezember 2024 in Kraft und muss bis Dezember 2026 in nationales Recht umgesetzt werden (Quelle: Amtsblatt der Europäischen Union, 2024).

Der europäische Rechtsrahmen: AI Act und Produkthaftungs-Richtlinie

AI Act: KI-Regulierung auf Risikobasis

Die Europäische Union hat mit dem AI Act das weltweit erste umfassende Regelwerk für KI-Systeme geschaffen. Er klassifiziert KI-Anwendungen nach vier Risikostufen: minimales Risiko, begrenztes Risiko, Hochrisiko und inakzeptables Risiko. Letzteres umfasst Anwendungen, die vollständig verboten sind – etwa Social-Scoring-Systeme staatlicher Behörden oder Echtzeit-Biometrie zur Massenüberwachung im öffentlichen Raum.

Als Hochrisiko gelten unter anderem KI-Systeme in der Strafverfolgung, im Bildungswesen, in der Personalauswahl, im Kreditwesen sowie in der kritischen Infrastruktur. Für diese Kategorien gelten strenge Anforderungen: Entwickler müssen Trainings- und Testdaten umfassend dokumentieren, kontinuierliche Risikoanalysen durchführen, ein zertifiziertes Qualitätsmanagementsystem etablieren und ihre Systeme in einer EU-Datenbank registrieren. Hinzu kommt die Pflicht zur menschlichen Aufsicht: Hochrisiko-KI darf nicht vollständig autonom agieren, ohne dass eine qualifizierte Person die Ausgaben kontrolliert und übersteuern kann.

Technologischer Hintergrund

Entscheidend ist jedoch: Der AI Act ist primär ein Compliance-Rahmen, kein Haftungsgesetz. Er legt fest, wer welche Sorgfaltspflichten erfüllen muss – aber er schafft kein eigenständiges zivilrechtliches Haftungsregime. Wer nach einem KI-bedingten Schaden Schadensersatz will, muss weiterhin auf bestehende Instrumente zurückgreifen.

Produkthaftungs-Richtlinie: Modernisierung mit Lücken

Genau hier setzt die überarbeitete EU-Produkthaftungs-Richtlinie an. Die ursprüngliche Richtlinie aus dem Jahr 1985 war auf physische Produkte ausgelegt – sie kannte keine Software, keine lernenden Systeme, keine digitalen Dienste. Die neue Fassung, die im Dezember 2024 verabschiedet wurde, schließt nun ausdrücklich Software, KI-Systeme und digitale Produktkomponenten ein.

Hintergründe und Einordnung

Kernneuerung: Die Beweislastumkehr. Bisher musste der Geschädigte drei Dinge nachweisen – den Schaden, den Produktmangel und den kausalen Zusammenhang zwischen beidem. Gerade dieser Kausalitätsnachweis war bei KI-Systemen praktisch unmöglich: Wie beweist man, dass ein neuronales Netzwerk nicht einen statistisch normalen Fehler produziert hat, sondern einen vermeidbaren Mangel? Die neue Richtlinie erleichtert diesen Nachweis erheblich. Gerichte können unter bestimmten Bedingungen eine Kausalität vermuten, wenn das Produkt fehlerhaft war und der Schaden typischerweise auf einen solchen Fehler zurückzuführen ist.

Daneben wird der Begriff des „Fehlers" neu definiert. Ein KI-System gilt künftig auch dann als fehlerhaft, wenn es nicht die Sicherheitsanforderungen des AI Act erfüllt – womit die beiden Regelwerke erstmals systematisch verzahnt werden. Für Unternehmen bedeutet das: Wer AI-Act-Compliance vernachlässigt, riskiert nicht nur Bußgelder, sondern auch zivilrechtliche Haftung.

| Rechtsrahmen | In Kraft seit | Kernregelung | Haftungsrelevanz |

|---|---|---|---|

| Fehlerhaftes Update und Systemmängel | Laufend | Produktfehlerhaftung bei Softwareupdates | Hersteller haftet für Schäden durch fehlerhafte Updates |

| Infrastruktur-Fehler und kritische Systeme | Laufend | Betreiberhaftung bei Systemausfällen | Betreiber trägt Verantwortung für Zuverlässigkeit |

| Batterie und Produktlebensdauer | 2024 | Haftung für Verschleiß und Dauerhaftigkeit | Hersteller haftet bei unzureichender Lebensdauer |