Autonome Waffen: Das neue Wettrüsten der KI

USA, China, Russland — Stand der Technologie und Risiken

Mehr als 100 Staaten diskutieren seit Jahren über ein internationales Verbot tödlicher autonomer Waffensysteme — doch die drei mächtigsten Militärnationen der Welt treiben deren Entwicklung unterdessen mit beispielloser Geschwindigkeit voran. Das KI-gestützte Wettrüsten hat längst eine neue, gefährlichere Dimension erreicht: Maschinen, die ohne menschliche Freigabe töten können.

Drohnen, Roboter, Algorithmen: Die neue Anatomie des Krieges

Was lange nach Science-Fiction klang, ist inzwischen militärische Realität. Autonome Waffensysteme — in der Fachliteratur als „Lethal Autonomous Weapons Systems", kurz LAWS, bezeichnet — sind Waffen, die Ziele ohne direkte menschliche Steuerung identifizieren, verfolgen und bekämpfen können. Der Unterschied zu ferngesteuerten Drohnen ist fundamental: Nicht ein Mensch am Steuerknüppel entscheidet, wann der tödliche Befehl ergeht, sondern ein Algorithmus.

Laut einem Bericht des UN-Generalsekretariats aus dem Vorjahr haben mindestens 49 Staaten offiziell erklärt, sie entwickelten oder beschafften Technologien, die als autonome oder halbautonome Waffensysteme klassifiziert werden können. Die reale Zahl dürfte deutlich höher liegen, da viele Programme unter strengster Geheimhaltung ablaufen. Besonders besorgniserregend: Die drei dominierenden Akteure — USA, China und Russland — haben bislang jeden verbindlichen internationalen Rahmen abgelehnt. (Quelle: United Nations Office for Disarmament Affairs)

Der Ukraine-Krieg hat dabei als brutales Reallabor gedient. Drohnenschwärme, KI-gestützte Zielerfassungssysteme und automatisierte Gefechtsfeldüberwachung werden täglich erprobt. Berichte der Nachrichtenagentur Reuters dokumentieren, wie beide Seiten zunehmend auf KI-Systeme setzen, um die schiere Masse des modernen Artillerie- und Drohnenkrieges zu bewältigen — mit Folgen, die weit über das Schlachtfeld hinausgehen. Wie dramatisch Russland seine Verluste durch massive Rekrutierungsanreize zu kompensieren versucht, zeigt, wie sehr der Krieg auch ohne Roboter bereits die gesellschaftliche Substanz erschöpft — was den Druck, autonome Systeme einzusetzen, weiter erhöht.

Die drei Großmächte im direkten Vergleich

Die strategischen Ansätze der drei führenden Militärmächte unterscheiden sich erheblich — in Technologie, Doktrin und politischem Rahmen. Gemeinsam ist ihnen das Tempo: Alle drei haben ihre Investitionen in KI-gestützte Militärtechnologie innerhalb weniger Jahre drastisch gesteigert.

| Land | Investitionsvolumen (geschätzt, aktuell) | Schwerpunkt-Programme | Rechtlicher Rahmen | UN-Position zu LAWS |

|---|---|---|---|---|

| USA | ca. 1,8 Mrd. USD jährlich (Pentagon KI-Budget) | DARPA Autonomous Systems, Replicator-Initiative (Drohnenschwärme), Aegis-KI-Nachrüstung | DoD-Direktive 3000.09: Mensch muss „in the loop" bleiben — aber Ausnahmen möglich | Lehnt verbindliches Verbot ab, befürwortet „politische Erklärungen" |

| China | ca. 1,6 Mrd. USD jährlich (geschätzt, Quellen: SIPRI, CSIS) | CH-7 Kampfdrohne, autonome Unterseedrohnen, KI-Schwarmtechnik der PLA | Kein öffentliches Regelwerk; zivil-militärische Fusion als Staatsstrategie | Befürwortet Verbot „vollautonomer" LAWS — bei gleichzeitiger Entwicklung |

| Russland | Genaue Zahlen unbekannt; Fregat-M, Uran-9 Bodenroboter bekannt | Uran-9 Kampfroboter, KUB-BLA Suiziddrohne, Poseidon-Torpedosystem | Keine öffentlich bekannte Ethik-Direktive für LAWS | Lehnt jedes verbindliche Verbot kategorisch ab |

| EU/NATO | Fragmentiert; Deutschland plant Milliarden-Investitionen (s. unten) | Koordinierungsrahmen, keine eigene Großmacht-Autonomiestrategie | EU-KI-Verordnung erfasst militärische LAWS nicht | Mehrheit der EU-Staaten befürwortet verbindliche Regeln |

(Quellen: Stockholm International Peace Research Institute / SIPRI, Center for Strategic and International Studies / CSIS, United Nations Group of Governmental Experts on LAWS)

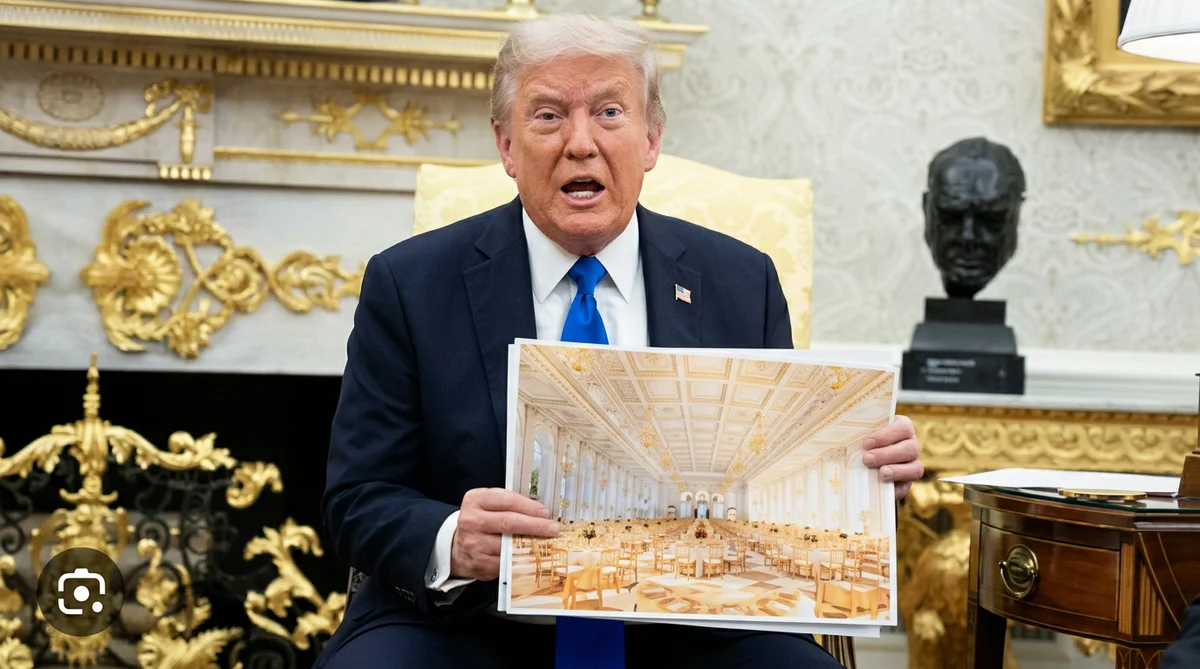

Die USA: Überlegenheit durch Quantität und Vernetzung

Washington verfolgt eine Doppelstrategie: Einerseits betont das Pentagon offiziell, dass ein Mensch immer die finale Entscheidung über tödliche Gewalt treffen müsse. Andererseits investiert das Verteidigungsministerium Milliarden in die sogenannte „Replicator"-Initiative, die darauf abzielt, innerhalb weniger Jahre Tausende günstiger autonomer Systeme zu bauen — primär als Gegengewicht zur numerischen Stärke Chinas im Pazifik, berichtet AP.

Die praktische Lücke zwischen Doktrin und Wirklichkeit ist erheblich. Kampfjets der F-16-Klasse werden mit KI-Kopiloten erprobt, die eigenständig Ausweichmanöver und Zielerfassung übernehmen können. Die DARPA finanziert Programme, in denen KI-Systeme Luftkämpfe gegen menschliche Piloten gewinnen — und das in Echtzeittests konsistent tun. (Quelle: Defense Advanced Research Projects Agency)

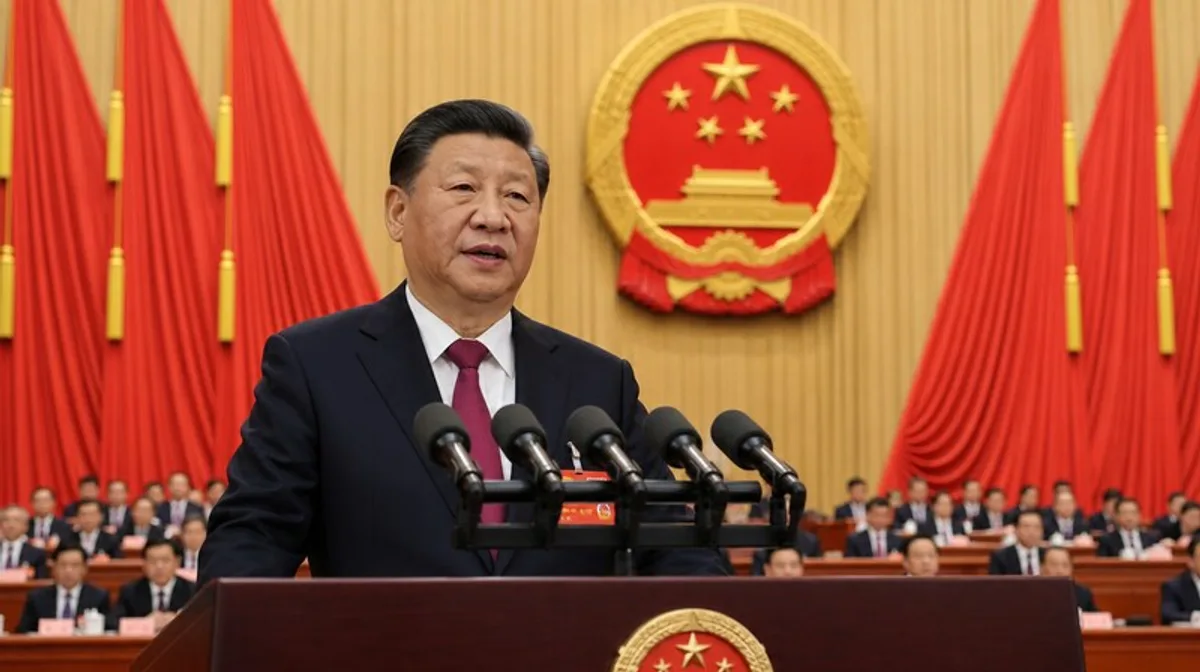

China: Zivil-militärische Fusion als strategischer Vorteil

Chinas Ansatz unterscheidet sich strukturell von westlichen Modellen. Die staatlich verordnete „zivil-militärische Fusion" zwingt Technologieriesen wie Huawei, Baidu oder DJI — weltweit größter Drohnenhersteller — zur Kooperation mit der Volksbefreiungsarmee. Das Resultat: Innovationen aus dem zivilen KI-Sektor fließen deutlich schneller in militärische Anwendungen als in demokratischen Staaten, wo Rüstungsbeschaffung an parlamentarische und ethische Hürden gebunden ist.

Wie tief diese Verzahnung von staatlicher Planung und technologischer Entwicklung in Chinas Gesellschaft reicht, zeigt auch ein Blick auf die demografische Transformation des Landes: Ein Jahrzehnt nach dem Ende der Ein-Kind-Politik kämpft China mit einer alternden Gesellschaft — was den strategischen Druck, Kampfkraft durch Automatisierung zu ersetzen statt durch Truppenstärke, massiv erhöht.

Besonders alarmierend für westliche Geheimdienste: Chinas autonome Unterseedrohnen sollen laut Berichten der Nachrichtenagentur dpa inzwischen in der Lage sein, monatelang ohne Wartung in gegnerischen Gewässern zu patrouillieren und eigenständig Objekte zu klassifizieren.

Die Risikodimension: Wenn Algorithmen über Leben entscheiden

Experten und UN-Gremien identifizieren mehrere Kategorien existenzieller Risiken, die autonome Waffensysteme von konventionellen Waffen unterscheiden.

Erstens das Eskalationsrisiko: Autonome Systeme reagieren in Millisekunden — schneller als diplomatische Kommunikation funktioniert. Ein fehlerhaft klassifiziertes Ziel, ein Softwarefehler oder ein feindlicher Hackangriff könnte eine Eskalationsspirale auslösen, die kein Mensch mehr rechtzeitig stoppen kann. Szenarien, in denen zwei autonome Verteidigungssysteme einander gegenseitig als Bedrohung klassifizieren und sich gegenseitig angreifen, sind in der Fachliteratur als „Flash War" beschrieben. (Quelle: Future of Life Institute)

Zweitens die Verantwortungslücke: Wenn eine Maschine einen Zivilisten tötet — wer trägt die Schuld? Der Programmierer? Der Kommandeur, der das System einsetzte? Das Unternehmen, das die KI entwickelte? Internationales humanitäres Recht setzt menschliche Verantwortung voraus. LAWS untergraben dieses Fundament systemisch, warnt das Internationale Komitee vom Roten Kreuz. (Quelle: International Committee of the Red Cross)

Drittens das Proliferationsrisiko: Je billiger autonome Systeme werden, desto zugänglicher werden sie für nicht-staatliche Akteure, Terrorgruppen und autoritäre Regime ohne internationale Rechenschaftspflicht. Die Verbindung von erschwinglicher Drohnentechnologie und KI-Zielerkennung ist bereits heute kein Privileg von Großmächten mehr. Dass deutsche Behörden IS-Mitgliederlisten sichern konnten, zeigt, wie ernst Terrororganisationen als potenzielle Nutzer hochentwickelter Technologien genommen werden müssen.

Wie real diese Bedrohung auch im Nahen Osten ist, illustriert ein weiteres Beispiel: Autonome Zielsysteme wurden in jüngsten Konflikten im Libanon-Raum eingesetzt — mit fatalen Konsequenzen auch für Zivilisten. Die Tötung einer Journalistin bei einem Luftangriff trotz bestehender Waffenruhe wirft grundlegende Fragen über die Präzision und Verantwortlichkeit moderner Targeting-Systeme auf.

Europa zwischen Aufrüstung und Regulierungsanspruch

Die Europäische Union steht in einem tiefen Widerspruch: Einerseits haben mehrere EU-Staaten beim UN-Rahmen für ein Verbot vollautonomer Waffen Unterstützung signalisiert. Andererseits rüstet Europa angesichts der veränderten Sicherheitslage so schnell auf wie seit Jahrzehnten nicht — und KI-gestützte Systeme sind ein zentraler Teil dieser Aufrüstung.

Die EU-KI-Verordnung, die als weltweit strengster Regulierungsrahmen für künstliche Intelligenz gilt, hat militärische Anwendungen explizit ausgespart. Das bedeutet: Die strengen Transparenz- und Haftungsregeln, die für zivile KI gelten, haben für Kampfdrohnen und autonome Waffensysteme keine Bindungswirkung. Kritiker sprechen von einer regulatorischen Leerstelle von geopolitischer Tragweite. (Quelle: European Parliament Research Service)

Deutschland-Bezug: Deutschland befindet sich in einer strategischen Zwickmühle. Einerseits hat die Bundesregierung international stets einen verbindlichen Rechtsrahmen für autonome Waffen gefordert und gehört zu den aktivsten Befürwortern einer UN-Konvention zu LAWS. Andererseits steht Berlin unter erheblichem Druck, die eigene Verteidigungsfähigkeit im NATO-Rahmen zu stärken — auch durch technologisch hochentwickelte Systeme. Die Bundeswehr erprobt bereits unbemannte Systeme für Aufklärung und Logistik; die Grenze zur Autonomie im Kampfeinsatz ist fließend. Besonders relevant: Deutschlands 35-Milliarden-Investition in militärische Raumfahrt ist untrennbar mit KI-gestützter Lageerkennung und autonomen Systemen verknüpft. Und innenpolitisch beobachtet die Sicherheitspolitik den gesellschaftlichen Konsens genau: CDU-Chef Friedrich Merz hat zuletzt Unbehagen über die gesellschaftliche Stimmung in Deutschland geäußert — eine Debatte über tödliche Roboter dürfte diese Spannungen weiter verschärfen. Deutschland muss in der NATO-Allianz funktionsfähig bleiben, während es gleichzeitig glaubwürdig für internationale Rüstungskontrolle eintreten will. Beides gleichzeitig zu erfüllen, wird zunehmend schwieriger.

Regulierung: Zu langsam für das Tempo der Technologie

Seit mehr als einem Jahrzehnt treffen sich Regierungsvertreter im Rahmen der UN-Waffenkonvention CCW in Genf, um über einen Rechtsrahmen für autonome Waffen zu verhandeln. Das Ergebnis ist ernüchternd: Es gibt keine verbindliche Vereinbarung, keine gemeinsame Definition von „vollautonomen Waffen" und kein Moratorium auf Entwicklung oder Einsatz. Russland blockiert systematisch jeden Fortschritt; die USA und China pochen auf nationale Souveränität in Rüstungsfragen. (Quelle: United Nations Convention on Certain Conventional Weapons / CCW)

Während die Diplomaten tagen, läuft die Uhr. Experten des SIPRI schätzen, dass in wenigen Jahren Systeme existieren werden, die autonom in Bruchteilen von Sekunden Entscheidungen treffen können, die mit heutigem internationalem Recht schlicht unvereinbar sind — ohne dass ein juristischer Rahmen zu ihrer Bewertung vorhanden wäre.

Eine wachsende Koalition aus mittleren Staaten, darunter Österreich, Neuseeland und viele Länder des Globalen Südens, drängt auf einen neuen Verhandlungsrahmen außerhalb der CCW — analog zum Ottawa-Prozess, der zu einem globalen Landminen-Verbot führte. Ob dieser Ansatz Erfolg haben kann, solange die drei größten Militärmächte außen vor bleiben, ist nach Einschätzung von Diplomaten und Experten jedoch fraglich. (Quelle: International Campaign to Stop Killer Robots)

Was bedeutet das für Deutschland und Europa konkret?

Für Deutschland und Europa ergibt sich aus dem globalen LAWS-Wettrüsten eine mehrschichtige Herausforderung. Militärisch steht Europa vor der Frage, ob es sich leisten kann, bei autonomen Systemen zurückzufallen — angesichts eines Russlands, das diese Technologien im Ukraine-Krieg erprobt, und eines Chinas, das sie im Indo-Pazifik zur strategischen Verschiebung des Kräfteverhältnisses nutzt.

Rechtlich und ethisch trägt Europa eine besondere Verantwortung. Die EU ist der einzige geopolitische Block, der sowohl militärisches Gewicht als auch normative Glaubwürdigkeit besitzt, um internationale Standards zu setzen. Wenn die EU-KI-Verordnung militärische Systeme dauerhaft ausspart, verspielt Europa diesen Vorteil.

Gesellschaftlich schließlich steht eine Debatte bevor, die weit über Rüstungsbudgets hinausgeht: Dürfen Gesellschaften Maschinen erlauben, im Namen des Staates zu töten — ohne dass ein Mensch in diesem Moment Verantwortung trägt? Diese Frage ist keine technische. Sie ist eine zutiefst politische, moralische und demokratische. Und die Zeit, sie zu beantworten, wird knapper — schneller als die meisten Parlamente bisher reagiert haben.

Weiterführende Informationen: Auswaertiges Amt