Meloni verurteilt Deepfake-Verbreitung als politischen Angriff

Italiens Ministerpräsidentin warnt vor manipulierten Inhalten und deren Gefahren für die Demokratie.

Mehr als zwölf Millionen Aufrufe innerhalb von 48 Stunden: Das ist die erschreckende Reichweite, die ein gefälschtes Pornografievideo mit dem Konterfei von Giorgia Meloni bereits erzielte, bevor italienische Behörden reagierten. Die Ministerpräsidentin bezeichnete die Verbreitung solcher Deepfakes nun öffentlich als koordinierten politischen Angriff — und entfachte damit eine Debatte, die weit über die Grenzen Italiens hinausreicht.

Meloni spricht von gezielter Destabilisierung

Italiens Regierungschefin Giorgia Meloni trat in einer ungewöhnlich persönlich gehaltenen Erklärung vor die Medien und ließ keinen Zweifel daran, wie sie die Situation bewertet. Die Verbreitung manipulierter Bildmaterialien, in denen ihr Gesicht auf pornografische Inhalte montiert wurde, sei kein bedauerlicher Einzelfall digitaler Enthemmung, sondern ein politisch motivierter Versuch, sie als Frau und als Regierungschefin zu diskreditieren. „Wer Deepfakes verbreitet, um politische Figuren anzugreifen, zielt nicht nur auf die Person, sondern auf die Demokratie selbst", ließ Meloni durch ihr Büro erklären. Die Staatsanwaltschaft Rom hat Ermittlungen eingeleitet, und ein US-amerikanisches Gericht hatte zuvor bereits zwei Personen zu Schadensersatzzahlungen in Höhe von über 100.000 Euro verurteilt — ein in Europa selten erzieltes Urteil im Bereich digitaler Falschinhalte.

Die Reaktionen aus dem europäischen Partnerland fielen gespalten aus. Während Teile der Opposition in Rom die Ernsthaftigkeit des Angriffs anerkannten, nutzten andere die Debatte, um Melonis Medienpolitik grundsätzlich zu hinterfragen. Ungeachtet dessen gewann das Thema rasch eine Dimension, die über persönliche Betroffenheit hinausgeht: Es ist inzwischen eine Grundsatzfrage, wie demokratische Gesellschaften mit synthetisch erzeugten Desinformationen umgehen wollen — und müssen. (Quelle: Reuters)

Deepfakes als Waffe im politischen Kampf — ein globales Phänomen

Der Fall Meloni ist symptomatisch für einen weltweiten Trend. Deepfake-Technologie, also die mithilfe künstlicher Intelligenz erzeugte oder manipulierte Audio- und Videoinhalte, hat sich in erschreckender Geschwindigkeit demokratisiert. Waren solche Produktionen noch vor wenigen Jahren ressourcenintensiv und auf spezialisierte Akteure beschränkt, genügt heute ein handelsüblicher Rechner und frei verfügbare Software, um überzeugend wirkende Fälschungen zu erstellen. Die Folgen sind gravierend: In rund 80 Ländern fanden in diesem Jahr Wahlen statt, und in fast allen davon wurden manipulierte Inhalte dokumentiert, die Kandidatinnen und Kandidaten in falsches Licht rückten. (Quelle: AP)

Besonders betroffen sind Frauen in politischen Ämtern. Laut einem Bericht des UN-Sonderberichterstatters für Meinungsfreiheit sind mehr als 70 Prozent aller politisch motivierten Deepfake-Angriffe gegen weibliche Persönlichkeiten des öffentlichen Lebens gerichtet. Diese Form der digitalen Gewalt zielt darauf ab, Frauen aus dem öffentlichen Raum zu verdrängen und ihnen politische Handlungsfähigkeit zu nehmen. Die UN bezeichneten Deepfake-basierte sexualisierte Gewalt gegen Politikerinnen als „eine der gravierendsten Bedrohungen für die politische Teilhabe von Frauen im digitalen Zeitalter". (Quelle: UN-Sonderberichterstatter für Meinungsfreiheit und freie Meinungsäußerung)

Der Angriff auf Meloni reiht sich in eine Serie ähnlicher Vorfälle ein. In Großbritannien wurden vor den Parlamentswahlen gefälschte Audioaufnahmen des damaligen Premierministers Rishi Sunak verbreitet. In Indien kursierten unmittelbar vor regionalen Abstimmungen manipulierte Videos von Oppositionsführern. Und in Südkorea sorgten Deepfake-Videos weiblicher Kandidatinnen für handfeste Justizfälle. Die politische Instrumentalisierung der Technologie ist längst keine Ausnahme mehr — sie ist Methode.

Rechtlicher Rahmen: Flickenteppich statt Einheitslösung

Die juristische Reaktion auf diese Entwicklung ist international uneinheitlich. Während in einigen asiatischen Staaten bereits spezifische Deepfake-Gesetze in Kraft sind, hinkt Europa trotz der Verabschiedung des AI Act strukturell hinterher. Der EU-Rechtsrahmen schreibt zwar vor, dass KI-generierte Inhalte entsprechend gekennzeichnet werden müssen, doch die Durchsetzung dieser Pflicht bleibt in der Praxis schwierig. Plattformen wie Meta, TikTok oder X haben zwar Richtlinien gegen Deepfake-Pornografie eingeführt, die Durchsetzung erfolgt jedoch reaktiv — und erst nachdem Inhalte oft schon millionenfach geteilt wurden. (Quelle: dpa)

In Italien selbst existiert bislang kein eigenständiges Deepfake-Strafrecht. Die Strafverfolgung erfolgt auf Basis allgemeiner Ehrschutz- und Datenschutznormen, was die Strafverfolgung erheblich erschwert. Das Justizministerium in Rom hat angekündigt, im Zuge der aktuellen Debatte einen legislativen Vorstoß zu prüfen, der synthetisch erzeugte Falschinhalte zu Wahlzeiten unter besondere Strafe stellen soll. Ein konkreter Gesetzentwurf liegt jedoch noch nicht vor.

Europäischer Kontext: Wenn Desinformation Grenzen ignoriert

Der Fall Meloni zeigt einmal mehr, dass Desinformation keine nationalen Grenzen kennt. Das gefälschte Video wurde auf Servern außerhalb der EU gehostet, über internationale Plattformen verbreitet und in mehreren Sprachen kommentiert — ein koordiniertes Muster, das Experten für digitale Sicherheitspolitik als charakteristisch für staatlich geduldete oder sogar geförderte Operationen beschreiben. Belege für staatliche Steuerung liegen im Fall Meloni bislang nicht vor, doch die strukturellen Parallelen zu bekannten Einflussoperationen sind unverkennbar.

Europäische Sicherheitsbehörden warnen seit Längerem, dass Akteure, die bereits in anderen Bereichen des Informationskrieges aktiv sind, zunehmend auf KI-gestützte Werkzeuge zurückgreifen. Wer die Intensivierung russischer Informationsangriffe auf die ukrainische Infrastruktur verfolgt hat, wird die Logik dahinter wiedererkennen: Glaubwürdigkeit wird nicht durch direkte Konfrontation zerstört, sondern durch anhaltende Verunsicherung und Erosion des Vertrauens.

Dass diese Strategien nicht auf Kriegsregionen beschränkt sind, zeigt die Debatte über die gesellschaftliche Stimmung in Deutschland, die von Bundeskanzler Friedrich Merz öffentlich thematisiert wurde. Auch hierzulande wächst die Sorge, dass digitale Desinformation die politische Kultur dauerhaft vergiftet.

Pressefreiheit unter Druck: Deepfakes treffen auch Journalistinnen

Nicht nur Politikerinnen, auch Journalistinnen sind Ziel solcher Angriffe. Die Ermordung einer Journalistin trotz einer vereinbarten Waffenruhe im Libanon hatte bereits international auf die extreme Gefährdung von Medienschaffenden in Konfliktregionen hingewiesen. Deepfakes stellen eine neue Dimension dieser Bedrohung dar — ohne physische Gewalt, doch mit dauerhaftem Schaden für Reputation und psychische Gesundheit der Betroffenen. Für Journalistinnen, die über sensible Themen berichten, können solche Angriffe eine Form indirekter Zensur darstellen, indem sie zur Selbstzensur aus Angst vor weiteren Angriffen führen. (Quelle: Reuters)

In diesem Zusammenhang ist auch die Transparenz von Informationsflüssen in anderen Konfliktkontexten relevant. Der Hamas-Angriff auf Israel hatte gezeigt, wie schnell und unkontrolliert sich gefälschte oder kontextfremde Bilder und Videos in sozialen Netzwerken verbreiten — noch bevor Faktenchecker eingreifen konnten. Der Deepfake-Angriff auf Meloni folgt derselben Dynamik: Das Ziel ist nicht die Überzeugung durch Argumentation, sondern die Schockwirkung und die Erosion von Vertrauen.

| Land | Regulierung von Deepfakes | Strafrahmen (bei Missbrauch) | Bemerkung |

|---|---|---|---|

| Deutschland | KUG, DSGVO, geplante KI-Ergänzungen | Bis zu 2 Jahre Haft (Ehrschutz) | Kein spezifisches Deepfake-Gesetz |

| Italien | Allgemeines Ehrschutzrecht | Bis zu 3 Jahre Haft | Gesetzesinitiative angekündigt |

| Vereinigtes Königreich | Online Safety Act (seit 2023) | Bis zu 2 Jahre Haft | Sexualisierte Deepfakes explizit strafbar |

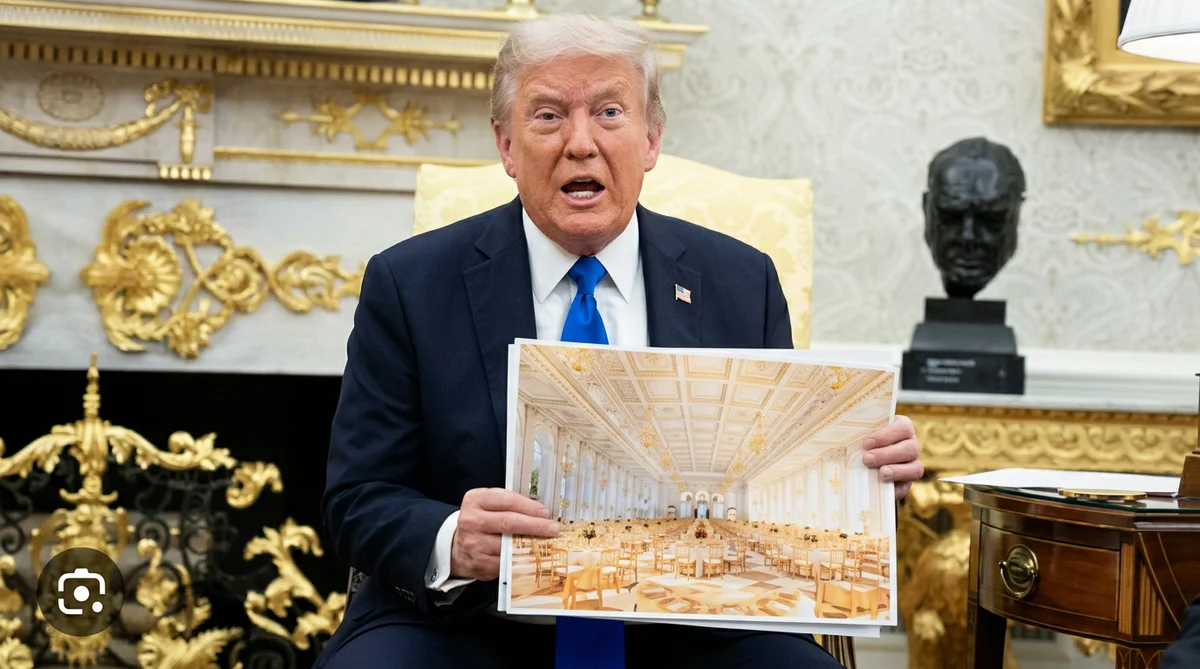

| USA | Bundesstaatlich unterschiedlich | Zivilrechtlich bis 150.000 USD | Kein einheitliches Bundesgesetz |

| Südkorea | Spezifisches Deepfake-Gesetz seit 2020 | Bis zu 5 Jahre Haft | Schärfstes Regime in der OECD |

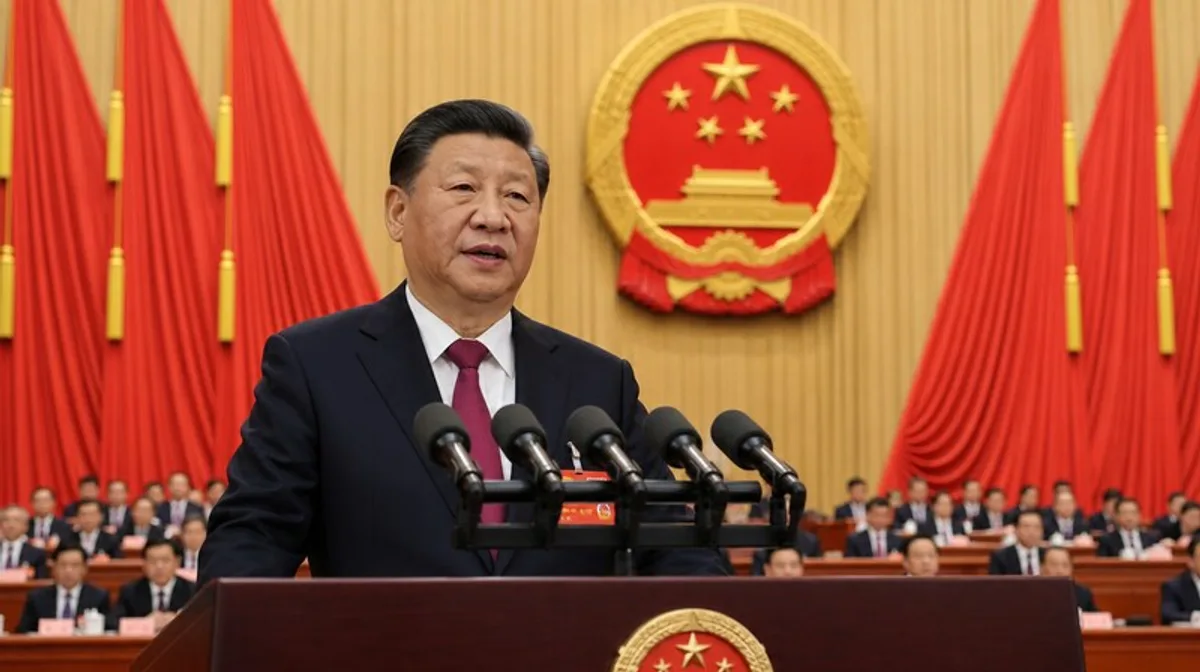

| China | Verordnung für synthetische Medien (2022) | Verwaltungsstrafen und Strafrecht | Starke staatliche Kontrolle |

Deutschland-Bezug: Deutschland verfügt bislang über kein eigenständiges Deepfake-Gesetz. Der Schutz vor manipulierten Bildinhalten erfolgt über das Kunsturheberrechtsgesetz (KUG), die Datenschutz-Grundverordnung (DSGVO) sowie allgemeine Ehrschutzparagraphen des Strafgesetzbuches. Der im Mai in Kraft tretende EU AI Act verpflichtet Anbieter zur Kennzeichnung KI-generierter Inhalte, enthält aber keine spezifischen Strafnormen für Deepfake-Missbrauch. Das Bundesjustizministerium prüft derzeit, ob und wie eine nationale Ergänzung des Rechtsrahmens notwendig ist. Experten des Deutschen Instituts für Menschenrechte fordern eine explizite Strafnorm für politisch motivierte Deepfakes, insbesondere zum Schutz von Kandidatinnen und Kandidaten in Wahlkampfphasen. (Quelle: dpa)

Was bedeutet das für Deutschland und Europa?

Der Fall Meloni ist ein Warnsignal für ganz Europa. In Deutschland stehen in den nächsten Jahren mehrere wichtige Wahltermine an — von Landtagswahlen bis zu Bundestagswahlen. Die Frage, ob die bestehenden rechtlichen Instrumente ausreichen, um Kandidatinnen und Kandidaten vor manipulierten Inhalten zu schützen, drängt sich auf. Verfassungsrechtler und Medienwissenschaftlerinnen sind sich einig: Der derzeitige rechtliche Rahmen ist für die Geschwindigkeit und das Ausmaß moderner Deepfake-Angriffe nicht ausgelegt.

Gleichzeitig warnen Bürgerrechtsorganisationen vor vorschnellen Überreaktionen. Ein zu eng gefasstes Deepfake-Gesetz könnte künstlerische Satire oder legitime politische Parodie treffen. Die Balance zwischen Persönlichkeitsschutz und Meinungsfreiheit zu finden, ist eine der komplexesten juristischen Aufgaben der Gegenwart. In Ländern wie China, wo autoritäre Strukturen zu drakonischen Urteilen führen, zeigt sich, wohin überzogener staatlicher Zugriff auf digitale Inhalte führen kann — ein Modell, das für liberale Demokratien keine Blaupause sein darf.

Europas Antwort auf die Deepfake-Herausforderung muss daher auf mehreren Ebenen erfolgen: legislativ mit klaren, verhältnismäßigen Normen; technisch durch verbesserte Erkennungswerkzeuge für Plattformen und Behörden; und gesellschaftlich durch Medienkompetenzprogramme, die Bürgerinnen und Bürger in die Lage versetzen, manipulierte Inhalte zu erkennen. Letzteres ist nicht Luxus, sondern demokratische Grundvoraussetzung — und eine Aufgabe, bei der Deutschland trotz erheblicher Bildungsinvestitionen noch erheblichen Nachholbedarf hat. (Quelle: AP)

Dass selbst religiöse Figuren höchster Prominenz nicht vor dem Phänomen der digitalen Verdrehung gefeit sind und ähnlich wie Papst Leo XIV. zwischen öffentlichem Amt und persönlicher Integrität navigieren müssen, zeigt: Deepfakes sind kein technisches Nischenproblem. Sie sind ein Angriff auf die Grundlagen öffentlicher Kommunikation in demokratischen Gesellschaften.

Melonis Reaktion, so politisch umstritten ihre Regierung auch ist, war in ihrer Klarheit richtig: Wer schweigt, normalisiert. Die Frage ist nun, ob Europas Institutionen schnell genug handeln, um die Demokratie vor einer Technologie zu schützen, die ihr schadet — bevor der Schaden irreparabel wird.

Weiterführende Informationen: Auswaertiges Amt

Quelle: Spiegel Ausland